ChatGPT署名权之争:

当AI“执笔”论文,著作权该归谁?

一、引言:生成式AI“闯入”学术界,署名权争议何去何从?

图1 ChatGPT图标

(图片来源:抖音)

随着生成式人工智能(如ChatGPT、Midjourney)技术的突飞猛进,学术界正经历一场静默的革命。从文献综述的自动化撰写、实验数据的智能分析,到论文初稿的生成与润色,AI已深度嵌入科研工作流程。

2023年9月27日,《Nature》杂志发布了其对1600多位科学家的调查报告。结果显示,科学家们普遍认为人工智能(AI)很快会成为科学研究的核心工具。事实上,早在ChatGPT被推出之前的2022年4月,针对4万多名科学家的调查就已经显示:48%的人自己直接开发或研究人工智能,30%的人在他们的研究中使用人工智能,只有22%的人在他们的科学中没有使用人工智能。

然而,这一技术红利背后暗藏法律与伦理的灰色地带:当一篇论文的署名栏赫然标注“ChatGPT”时,学界与法律界瞬间陷入激烈争议——AI生成内容是否应被视作“作品”?署名权究竟归属开发者、使用者,还是AI本身? 这一争议不仅关乎学术规范与知识产权法的适配性,更触及人类对“创造性劳动”本质的重新定义。

(数据来源:个人图书馆http://www.360doc.com/content/23/1004/02/22040340_1098887064.shtml)

二、案例聚焦:首例“使用AI代笔的SCI论文”事件启示

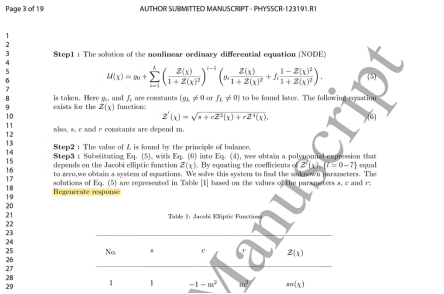

2023年8月9日,物理学期刊《物理写作》(Physica Scripta)杂志上发表的一篇旨在揭示复杂数学方程新解的论文,被指文中出现了“Regenerate response”(重新生成回复)的字样,系使用ChatGPT生成论文正文内容的痕迹,并且作者在投稿前错误地复制黏贴了生成按钮的标签。最终该论文被撤稿,这也是第一例因使用ChatGPT而撤稿的SCI论文。

图2 《Physica Scripta》中出现“Regenerate response”字样的论文页面

(图片来源:知乎)

事实上,据《自然》(Nature)杂志报道,这次事件只是学术界使用ChatGPT的冰山一角。截至2023年,全球已有逾1万篇学术论文被撤回,其中有9408篇论文出自欣达维(Hindawi)旗下的出版社,除了“同行评审欺诈、论文工厂和出售作者身份”等常见撤稿原因外,“使用AI”正在成为撤稿的一大主因。

事实上,自2023年起,国内外多个知名期刊就已纷纷对AI论文造假发布多项声明,一方面对AI在论文写作中的应用进行规范,提高了投稿门槛;另一方面对涉嫌论文进行退稿处置。例如,2023年9月20日,中国科学技术信息研究所发布《学术出版中AIGC使用边界指南》称,建议研究人员使用生成式人工智能(AIGC)直接生成的稿件文字等资料必须提供明确的披露和声明,否则将构成学术不端行为。2023年5月,国际医学期刊编辑委员会(ICMJE)也发布声明指出,建议使用了AI辅助技术的作者,应在投稿信和论文中说明如何使用这些技术,作者不应将AI和AI辅助技术列为作者或共同作者。

在ChatGPT生成学术论文的著作权归属的议题上,据人民日报记者不完全统计,《自然》(Nature)、《细胞》(Cell)、《柳叶刀》(The Lancet)、《美国医学会杂志》(JAMA)等顶级期刊均发表声明称,人工智能(AI)不具有作者资格,使用人工智能(AI)的研究人员应在稿件中进行说明。这要求现如今的学术机构必须更加注重并规范人工智能(AI)的使用。

(资料来源:华医网https://mp.weixin.qq.com/s?__biz=MjM5MTA5NDcwOQ==&mid=2655955198&idx=2&sn=ce18a55a115e15fb15c9c55e04eb0440&chksm=bcb84cb60156bb575b2a8502db51c90db6e3b6c7acde13aeee1524f37a977d5020f893798aaa&scene=27)

三、法理深析:为何ChatGPT生成内容不构成“智力成果”?

2023年,厦门大学知识产权研究院的甄心奇发表论文《ChatGPT生成作品的著作权认定》,其通过以著作权的主体、客体和内容为视角出发对ChatGPT生成作品的著作权问题进行判定,系统论证了AI生成内容无法满足著作权法“智力成果”要件的三大法理障碍。

1. 创作主体资格的绝对缺失

著作权法的核心在于保护“人类思想与情感的表达”。即使AI输出内容看似新颖,其本质仍是训练数据中人类作品的衍生品,而非独立的思想表达。

正如“算法无‘创作之心’,代码无‘署名之权’”,ChatGPT虽能生成流畅文本,但其运作本质是概率模型下的数据拟合,缺乏自主创作意图与情感投射。

2. 独创性判断的结构性矛盾

著作权法要求作品体现作者个性化的选择与编排。然而,ChatGPT的生成过程受限于预设算法与数据集的边界,其“创作”实质是对已有内容的模仿与重组。其可以作为用户强大的“写作伙伴”而加以利用,却不能成为具有独立人格的主体去进行独立的创作。

尽管“作者中心主义” 的理论基础在人工智能时代会有所动摇,但当前的人工智能技术依然无法突破“为人类所操控”和获得“自主意志”的技术背景。

3. 责任链条的断裂风险

署名权不仅意味着权利,更要求作者对内容的真实性、合法性负责。AI无法理解“学术诚信”的伦理内涵,更无法承担抄袭、数据造假或结论误导的法律后果。若允许AI署名,一旦论文出现争议,责任主体将陷入模糊状态,学术信任体系恐遭瓦解。

l 学界共识与立法趋势

(1) 2024年2月,国际知识产权组织(WIPO)发布的《生成式人工智能:知识产权导航》报告中明确指出,“人工智能是工具而非创作者,其输出需经人类智力加工方可纳入版权保护。”

(2) 2020年11月,《中华人民共和国著作权法》(以下简称《著作权法》)进行第三次修正,其中第十一条第四款修改为第十二条第一款,同时明确规定,“在作品上署名的自然人、法人或者非法人组织为作者,且该作品上存在相应权利,但有相反证明的除外。”可以看出,人工智能并不在其列,即我国在立法层面中,并没有直接支持ChatGPT成为著作权的主体。

(原文链接:知产力https://baijiahao.baidu.com/s?id=1760250372503432677&wfr=spider&for=pc)

四、结语:构建人机协作时代的学术署名新秩序

生成式AI的学术应用已成不可逆之势,但技术的狂奔需以法律与伦理的缰绳约束。为化解署名权争议,需构建多方协同的治理框架:

1. 法律层面:强化“人类主导性”原则

以《著作权法》修订为契机,细化AI生成内容的使用规则。例如,可借鉴欧盟《人工智能法案》的“透明度义务”,要求使用者在论文中标注AI参与的具体环节(如“数据分析由ChatGPT 4.0完成,经人工校验”),并承诺对内容的科学性负责。

2. 学术共同体:制定标准化声明机制

期刊、高校应联合推出《AI使用伦理指南》,强制作者披露AI工具名称、版本、贡献比例及验证方式。《自然》(Nature)杂志已率先要求投稿者填写“AI辅助声明表”,详细说明AI在数据收集、文本生成等环节的作用。

3. 技术赋能:开发“AI生成内容溯源工具”

通过数字水印、区块链存证等技术,为AI生成内容添加可追溯的“数字指纹”。例如,OpenAI正测试“AI检测器”,可识别ChatGPT生成文本的独特模式;学术机构亦可引入“数据血缘分析系统”,追溯论文中AI生成内容与训练数据的关联性,防范隐性抄袭。

最后,“工具无署名,责任在人心”——唯有厘清AI的“工具”本质,筑牢学术伦理防线,方能在人机协作的新纪元中,守护科研创新的纯粹性与公信力。

【法律条款速查】:扫码直达法规原文

图3 《中华人民共和国著作权法》

图4 《生成式人工智能:知识产权导航》